ニュース

「Claude」の作業を「GPT-5.4」が批判、「GitHub Copilot CLI」に新機能「Rubber Duck」

AIのセカンドオピニオンで問題の芽を摘み取る

2026年4月7日 09:12

米Microsoft傘下のGitHubは4月6日(現地時間)、「GitHub Copilot CLI」の新機能「Rubber Duck」を発表した。メインのエージェントと異なるモデルファミリーにメインエージェントの計画やレビューさせる、いわばセカンドオピニオン機能だ。

コーディングエージェントは計画、実装、テストのループで動作するが、初期工程に誤った判断があると、後工程で大きな問題に発展しやすい。そのため、それぞれの工程で誤りがないかチェックするレビューが有効となる。しかし、レビューをメインのエージェントと同じモデルにやらせても、同じ盲点を抱えていればよい結果は得られないだろう。

そこで考案されたのが「Rubber Duck」だ。たとえばメインモデルに「Claude Sonnet」を利用している場合、「Rubber Duck」はその批評モデルとして、「GPT‑5.4」といった他社製モデルを採用する。「GPT‑5.4」は「Claude Sonnet」と異なる視点やアプローチを備えているので、「Claude Sonnet」が見落としやすい不具合や設計の際に混入する前提のズレ、複数ファイルにまたがる依存関係の破綻、テストの抜け漏れなどを鋭く指摘できるだろう。「Rubber Duck」という名前は、アヒルのおもちゃに1行ずつコードの説明をすると、その過程で問題点を発見したり、よりよい解決策を思いつくことがあるという「ラバーダック デバッギング」に由来するようだ。

実際、同社のテストによると、「Claude Sonnet」と「Rubber Duck」(GPT-5.4)の組み合わせは、同じ「Claude」の「Sonnet」と「Opus」を組み合わせた場合に比べ、ステップ数が長く、多くのファイルにまたがる難しい問題で大きな改善が見られたとのこと。

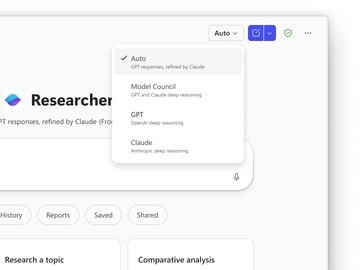

こうしたメインモデルと批評モデルを組み合わせることで出力品質を改善する取り組みは、Microsoftの調査エージェント「Researcher」でも、同様の仕組み「Critique」がテストされている。今後のトレンドになるのかもしれない。

なお、「GitHub Copilot」は「Rubber Duck」を開発ループの適切なタイミングで自動で呼び出すため、開発者側は「Rubber Duck」を使いこなそうと意識する必要はない。しかし、必要であれば明示的に呼び出して、より深く開発プロセスをレビューさせることもできる。

「Rubber Duck」は現在、「GitHub Copilot」の実験モード(/experimental)で提供中。モデルピッカーから任意の「Claude」モデルを選択し、「GPT-5.4」へのアクセスを有効にすると「Rubber Duck」が利用できる。

今のところメインモデルと批評モデルの組み合わせは「Claude」モデルと「GPT-5.4」の組み合わせに限られているが、この制限は今後緩和される見込みだ。