ニュース

Microsoft、「Foundry Local」を一般提供 ~ローカルAIのアプリ組み込みをまるごと支援

デバイスに最適なモデル選びから、アクセラレーションまで

2026年4月13日 12:57

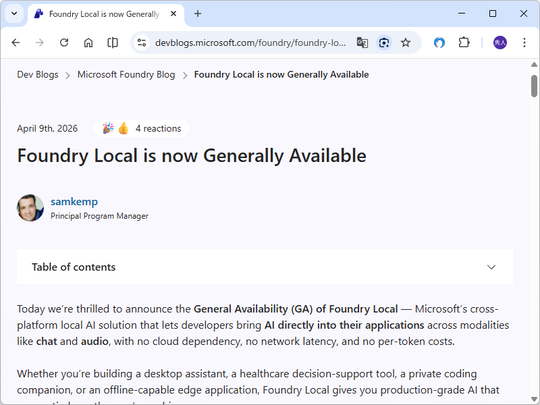

米Microsoftは4月9日(現地時間)、ローカルAIソリューション「Foundry Local」の一般提供(GA)を発表した。

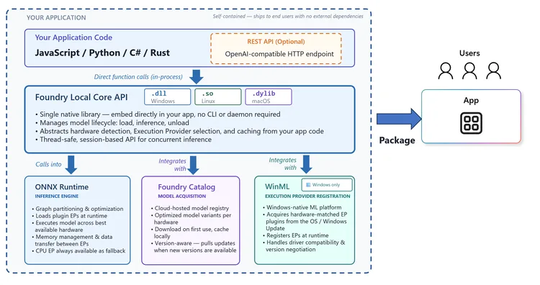

「Foundry Local」はローカルAIモデルをクラウド依存なし、ネットワーク遅延なし、トークン課金なし、ユーザー設定なしで利用できるようにするクロスプラットフォーム(Windows、macOS、Linux)対応のソリューション。「Foundry Catalog」に収録されたローカルAIモデルをデバイスハードウェアに最適化された状態でダウンロードし、テキストや音声といった複数のモダリティにわたるAI機能をアプリケーションに直接組み込めるようにしてくれる。デスクトップアプリにプライベートなAIアシスタントを組み込んだり、オフライン環境でも動作するエッジアプリに音声入力や文字起こしといったAI機能を追加したりといった用途に利用できる。

同社はクラウドからエッジデバイスまでを包括するAIプラットフォームとして「Microsoft Foundry」を展開しているが、「Foundry Local」はその一翼を担うソリューションで、デスクトップPCやノートPC、(いずれは)スマートフォンなどをカバーする。

- 自己完結型:「Foundry Local」さえあればローカルAIが利用できる。サードパーティー製アプリなどの外部依存関係を持たず、AIを動かすにあたりユーザーがなにか設定する必要もない

- すべてのAI機能を統一したSDK(ソフトウェア開発キット)。音声入力、ツール呼び出し、チャットなどの機能がひとまとめになっており、特定の機能を実装するのに他のSDKが必要となるといったことはない

- 自動ハードウェアアクセラレーション:NPU搭載、GPUあり、CPUのみといったハードウェア構成を自動検出し、AIモデルを最適化

- リアルタイムUX:回答が完了するまで待つのではなく、トークンごとにストリームレスポンスを行うためリアルタイム感を演出できる

- オフライン動作:ユーザーデータがデバイスの外に送信されることはない。応答はネットワーク遅延ゼロ

- 多言語対応:C#、Python、JavaScript、Rustをサポート

- 自動再開:AIモデルのダウンロード中にネットワーク接続が失われても、前回のところからダウンロードを再開できる

- キュレーションされたモデルカタログ:「Foundry Catalog」で最適化済みのローカルモデルを提供

►gpt-oss

►Qwen

►Whisper

►DeepSeek

►Mistral

►Phi - クロスプラットフォーム対応:Windows、macOS(Apple Silicon)、Linux(x64)をサポート

- OpenAI互換のHTTPエンドポイント

たとえば「Foundry Local」をPythonで始めるには、以下のコマンドが利用できる。Windows環境の場合、「Windows ML」対応のSDKを利用することでハードウェアアクセラレーションの恩恵を受けられる。

# Windows(ハードウェアアクセラレーション推奨)

pip install foundry-local-sdk-winml

# macOS / Linux

pip install foundry-local-sdk

![【Amazon.co.jp限定】1冊ですべて身につくHTML & CSSとWebデザイン入門講座[第2版] (特典:「Webデザイナーのポートフォリオの作り方入門講座」データ配信) 製品画像:5位](https://m.media-amazon.com/images/I/51skMJ-OVcL._SL160_.jpg)