ニュース

Google、「Gemini 3 Flash」の新しい視覚機能「Agentic Vision」を発表

パッと見るだけでなく、もっと詳しく調べるべき点はPythonも力を借りて拡大・徹底調査

2026年1月28日 15:45

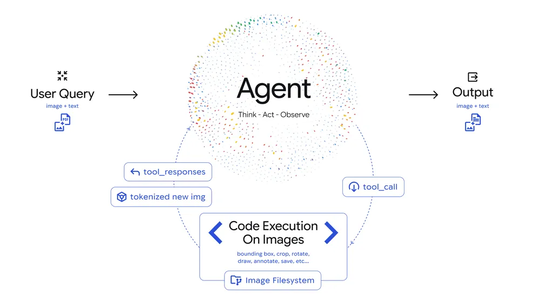

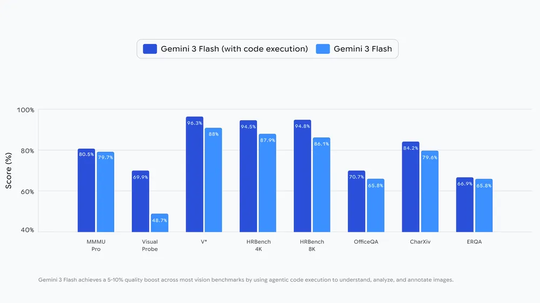

米Googleは1月27日(現地時間)、「Gemini 3 Flash」の新しい視覚機能「Agentic Vision」を発表した。従来からある「Gemini Vision」が単に画像を読み取り、その場で一回きりの応答を行っていたのに対し、「Agentic Vision」は考える(Think)、実行する(Act)、観察する(Observe)のループで細部を徹底的に調査し、応答の精度を向上させるのが特徴だ。

これまでの生成AIのなかにも視覚入力をサポートするものは少なくないが(マルチモーダル)、それは“静的で一回きり”の画像理解でしかなかった。たとえばマイクロチップのシリアルナンバーや遠くの街路標識のような細かい点を一度見逃してしまうと、あとは推測に頼らざるを得ない。そのため、不正確な応答が引き出されてしまう。

しかし、「Agentic Vision」はそうではない。もっと詳しく調べるべきディテールを検知すると、「Agentic Vision」は画像を操作(ズーム、トリミング、回転、注釈、解析)する「Python」コードを生成・実行し、その結果をAIモデルのコンテキストウィンドウ(文脈)に追加する。AIモデルは得られた追加の画像データをもとに思考を深め、裏付けのある、より正しい応答を返す。つまり、画像認識でも“能動的に調査”するようになる。

推測ではなく計算で行うべき視覚分析を決定論的(何度試しても結果が同じであること)な「Python」環境にオフロードする(移す)という「Agentic Vision」の特徴は、生成AIにありがちな“錯覚”を排除するのに有効だ。また、推測ではなく“根拠”が必要となる画像認識にも向いている。

「Gemini 3 Flash」の「Agentic Vision」は現在、「Vertex AI」のGemini API経由や「Google AI Studio」で利用可能。「Gemini」アプリにも順次展開され、「思考モード」(Thinking)選択時に利用できるようになるとのこと。

同社によると、現段階の「Agentic Vision」で暗黙的に行う画像操作はズームだけで、回転や計算による分析などは明示的に指示する必要がある。しかし、今後の改善で他の画像処理もプロンプトの追加なしで行えるようにするとのこと。また、Web検索やリバース画像検索などのツールを搭載して世界の理解をより深めたり、「Flash」以外の「Gemini 3」ファミリーに展開することも計画しているという。